Infrastrukturelle Voraussetzungen für den Einsatz von KI – am Beispiel des fiktiven Herrn Müller

Welche Infrastruktur muss für den Einsatz von KI gegeben sein?

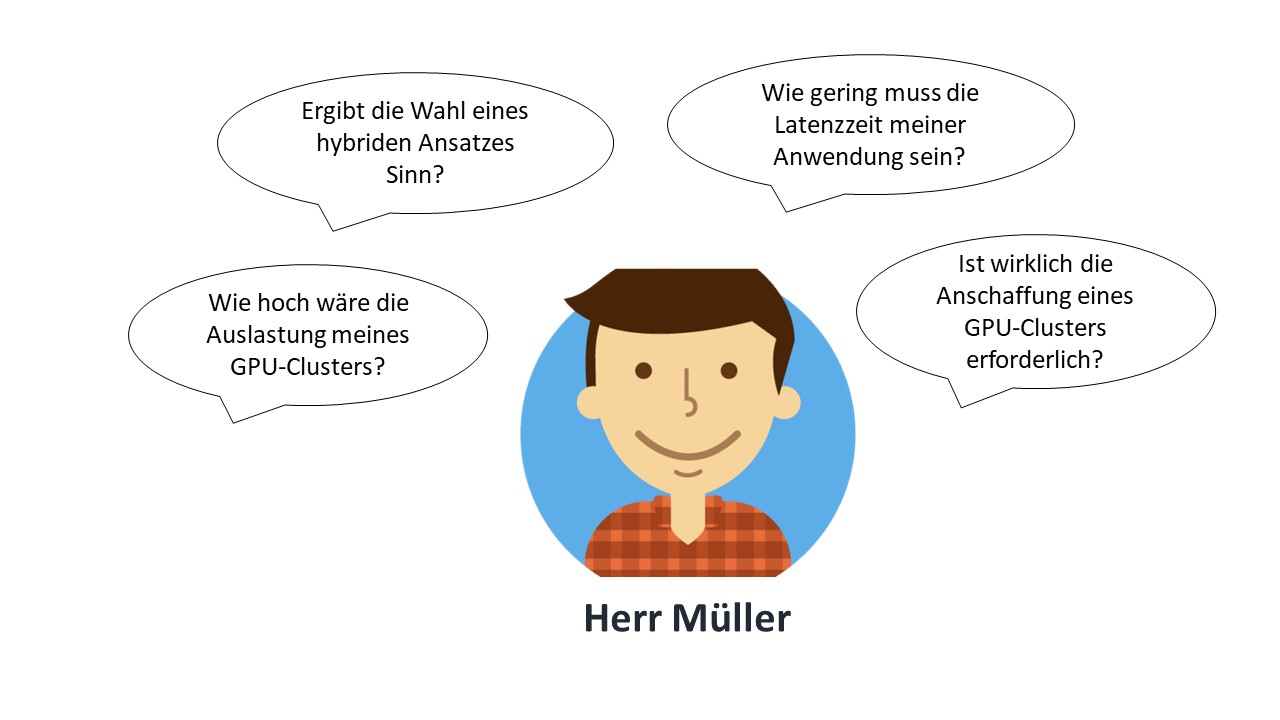

Herr Müller arbeitet als Produktionsleiter in einem mittelständischen Maschinenbauunternehmen. Auf einer Fachtagung hat er von dem Potenzial gehört, die der Einsatz von KI-basierten Technologien in der Produktion birgt. Nun fragt er sich, welche infrastrukturellen Voraussetzungen in seinem Unternehmen gegeben sein müssen, damit er KI-basierte Technologie einsetzen kann. Ein Dozent der Fachtagung hat ihn im Nachgespräch nur mit folgenden Worten vertröstet:

Was gilt es bei der Datenspeicherung zu bedenken?

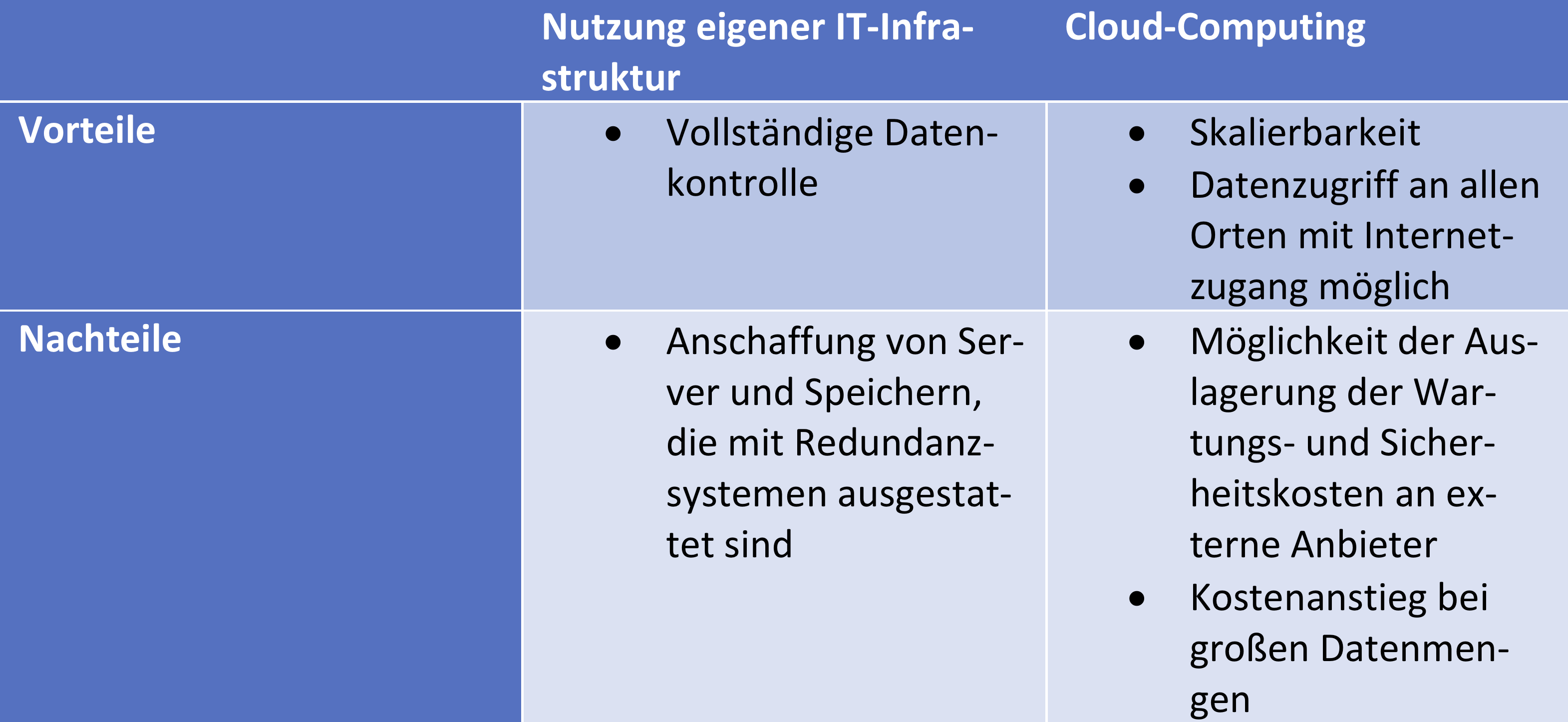

In KI-Ratgebern liest Herr Müller, dass die Güte eines KI-Modells im Allgemeinen mit zunehmender Menge an verfügbaren Trainingsdaten zunimmt. Gleichzeitig nimmt jedoch auch der Speicheraufwand zu. Deshalb fragt er sich, ob die eigene IT-Infrastruktur in der Lage ist, alle Daten zu speichern. Alternativ könnte er mit dem IT-Abteilungsleiter besprechen, ob die Nutzung externer Cloud-Dienste realisierbar ist.

Herr Müller möchte gerne sensible Maschinendaten verarbeiten, weshalb eine vollständige Datenkontrolle für das Unternehmen wichtig ist. Wenn die Server des Cloud-Computing-Anbieters zur Datenspeicherung jedoch nicht in einem Mitgliedsstaat der EU stehen, werden womöglich nicht die Vorschriften der europäischen Datenschutzgrundverordnung eingehalten.2 Folglich besteht vor allem bei der Nutzung sogenannter Public Clouds die Gefahr eines Kontrollverlusts. Aus vergangenen IT-Projekten kann sich Herr Müller jedoch denken, dass für die Nutzung der eigenen IT-Infrastruktur erhebliche Investitionen in Server und Speicher erforderlich wäre. Diese müssten mit Redundanzsystemen ausgestattet sein, um einen Datenverlust im Falle eines Systemausfalls zu verhindern. In seinem Unternehmen mangelt es jedoch generell an fachkundigem IT-Personal, welches die Infrastruktur warten und instand setzen kann. Dahingegen ermöglicht eine Cloud-Lösung eine gute Skalierbarkeit, welche eine stetige Anpassung der Speicherplatzanforderungen an die aktuellen Bedürfnisse ermöglicht, ohne dass neue Serversysteme angeschafft werden müssen. Im Gespräch mit seinem IT-Abteilungsleiter erfährt er zudem, dass das Sicherheitslevel der Cloud-Lösungen etablierter Anbieter als hoch einzuschätzen ist. Zum Glück erfordert seine Anwendung, anders als zum Beispiel Echtzeit-Anwendungen, keine sehr geringe Latenzzeit beim Datenabruf. Echtzeit-Anwendungen verbieten den alleinigen Einsatz von Cloud-Lösungen, da die Bandbreite der Internetverbindung zu gering und in der Regel vor allem zu unzuverlässig ist.

- Public Cloud: Angebot des Cloud-Anbieters ist frei zugänglich, d.h. mehrere Organisationen nutzen diese simultan. Bekannte Anbieter sind Amazon Web Services (AWS), Microsoft Azure oder Google Cloud Plattform.

- Private Cloud: Cloud-Angebot wird nur von einer Organisation genutzt. Das Hosting erfolgt entweder durch die Organisation selbst oder durch einen externen Cloud-Anbieter.

- Zudem existieren Mischformen, die hybride Clouds genannt werden.

Welche Anforderungen bestehen an die Rechenleistung?

In IT-Fachzeitschriften liest Herr Müller immer wieder, dass für das Trainieren von großen KI-Modellen hoch spezialisierte Grafikprozessoren (GPUs) eingesetzt werden. Der Einsatz von Grafikprozessoren verkürzt im Vergleich zu CPUs die Trainingszeit und erhöht die Energieeffizienz. Der IT-Abteilungsleiter berichtet ihm jedoch, dass für die anschließende Anwendung des trainierten KI-Modells im sogenannten Inferenzbetrieb eine geringere Rechenleistung erforderlich ist, die oft keine GPU-Cluster erfordert. Vor dem Hintergrund der hohen Kosten eines GPU-Clusters sollte daher überprüft werden, wie hoch die Auslastung des GPU-Clusters wäre. Muss das KI-Modell selten erneut trainiert werden, kann es sinnvoller sein, einen hybriden Ansatz zu wählen. Für das Modelltraining wird Rechenleistung bei externen Cloud-Anbietern angemietet, wohingegen für den Inferenzbetrieb die eigene Infrastruktur genutzt wird. Somit kann der Aufbau einer zweiten IT-Infrastruktur speziell für KI-Anwendungen vermieden werden.

Herr Schmidt erklärt Herrn Müller darüber hinaus, dass für einfachere Aufgabenstellungen kleinere KI-Modelle ausreichen, welche keine hoch spezialisierten GPU-Cluster erfordern. Herr Schmidt versichert Herr Müller zu prüfen, ob freie Ressourcen in der vorhandenen IT-Infrastruktur bestehen, auf welche zurückgegriffen werden kann. Grundsätzlich sind Serversysteme mit CPUs flexibler einsetzbar als GPUs. Diese Vorteile zeigen sich beispielsweise bei der Datenvorverarbeitung und anschließenden Auswertung der Ergebnisse eines KI-Modells, welche einen großen Teil der Entwicklungszeit einer KI-Lösung einnehmen. Neben der Skalierbarkeit einer IT-Infrastruktur für größere KI-Modelle sind deshalb für Herrn Schmidt auch die Flexibilität und Effizienz weitere Entscheidungskriterien. Die vorhandene IT-Infrastruktur muss neben den Anforderungen der KI-Lösung auch beispielsweise die Anforderungen des Warenwirtschafts- und Kundenmanagementsystems unterstützen. Herr Schmidt gibt zudem zu Bedenken, dass der Aufbau einer separaten IT-Infrastruktur die Komplexität der IT-Infrastruktur erhöhen würde. Er müsste prüfen, ob seine Abteilung neue Mitarbeiter benötigen würde, um die Infrastruktur zu verwalten und zu pflegen.

Zusammenfassend kommt Herr Müller zu dem Schluss, dass weder gut ausgebaute Speichersysteme noch eine hohe Rechenleistung allein ausreichen. Wichtig ist, dass beide gut aufeinander abgestimmt und mit der restlichen IT-Infrastruktur kompatibel sind.

Quellenverzeichnis

1. o. A. (2022). Die Vorteile und Nachteile des Cloud-Computing.

2. Petzold, M. (2022). Cloud Computing und Datenschutz – Eine Einführung.